你肯定遇到过这种情况。你从管理系统、电商数据源、银行系统或内部API接收到了一个XML文件。你知道里面包含订单、产品明细、交易记录、主数据或有用的事件。但打开文件后,看到的只有标签、节点和属性。此时,问题不在于数据本身,而在于格式。

对于许多企业而言,XML转Excel是技术数据交换与运营分析之间的关键环节。 在意大利,这一问题尤为突出:68%的意大利IT企业使用XML进行数据交换,但仅有42%的企业将数据转换为Excel格式进行分析,效率差距高达26%(conversiontools.io)。这种差距导致报告生成速度变慢、手动工作量增加,以及用于解读关键数据的时间减少。

对于许多团队而言,Excel 仍是理所当然的首选工具。财务部门用它进行核对,零售部门用它来核对产品目录和订单,分析师则用它来清理、筛选数据并生成快速视图。关键不在于单纯地进行数据转换,而在于根据数据流的结构、体量和频率选择合适的方法。如果选择错误,虽然数据能导入,但整个流程将无法实现规模化。

一位分析师从订单系统接收XML导出文件。一位财务主管下载结构化格式的对账单或交易明细。一个运营团队从ERP或API导出数据。他们都面临同样的情况:数据虽然存在,但尚未以业务所需的格式呈现出来。

XML 在实现系统间通信方面表现出色。但当需要比较数值、创建数据透视表、检查异常或构建预测模型时,它并非最佳选择。这时,Excel 就派上用场了。它操作熟悉、响应迅速,最重要的是,许多决策过程正是在这里成形的。

难点在于,将XML转换为Excel并没有唯一正确的解决方案。简单的文件可以通过Power Query顺利转换。分层XML通常需要使用XSLT。对于需要处理大量重复数据或多文件的情况,则更倾向于使用Python。对于快速处理的任务,一些团队甚至会考虑使用在线转换工具,但这显然会在可控性和安全性方面做出妥协。

最佳选择取决于三个实际因素:结构的复杂程度、文件数量以及所需的自动化程度。如果在导入前先考虑这些因素,不仅能立即节省时间,还能在后续阶段——即数据开始用于生成报告和辅助决策时——减少错误。

对于大多数企业团队而言,Power Query 是最稳妥的起点。它已内置于 Excel 中,无需编写代码,且可在不离开日常工作环境的情况下,将 XML 转换为表格。

基本流程如下:

在标准IT数据集上,该方法的成功率为92%, 其中75%的错误源于多命名空间,这一问题通常可在Power Query的高级选项中解决(Beyond Japan)。

如果你经常处理其他表格格式,这份关于在Excel中管理CSV文件的基础指南或许对你有所帮助,因为其数据清理、类型转换和最终导入的逻辑非常相似。

在以下情况下,Power Query 运行良好:

实用建议:在展开节点后立即重命名列。如果等到最后再操作,混淆同名字段的风险会大大增加。

Power Query 并非魔法。如果 XML 结构嵌套得很深,逐步展开可能会导致表重复、行重复,或者父子实体之间的关系不明确。此外,导入的字段类型错误的情况也很常见,尤其是日期、布尔值和数值。

做好这两点检查,就能避免许多问题:

对于月度报告、运营对账和临时分析,Power Query 通常是最佳选择。它能快速将技术文件转换为易于阅读的表格。其商业价值显而易见:减少数据准备时间,从而有更多时间用于解读结果。

如果你想尽快向决策者提交一份报告,这通常是首选的方法。

当Power Query能够导入文件但无法准确解析其逻辑时,就需要更精细的控制。XSLT正是为此而生。它不会试图猜测最终表格应呈现何种形态,而是由您来定义。

XSLT 在处理分层 XML、非标准结构的源数据以及必须遵循固定规则的输出布局时尤为有用。如果最终的 Excel 表格必须符合特定的企业结构,这种方法比拖放操作要可靠得多。

该方法需要创建一个样式表,例如使用如下模板: <xsl:template match='*'>,以生成一个Excel XML工作表。 在经过验证的XML文件中,成功率为88%. 最常见的问题显而易见: 60% 的失败是由于字符串过长造成的,30% 则是由于布尔数据丢失造成的. 在性能方面, 在处理100MB的数据集时,XSLT的效率是拖放操作的3倍 (TechRepublic).

使用 XSLT,您可以预先决定:

| 需求 | Power Query | XSLT |

|---|---|---|

| 无需代码快速导入 | 非常适合 | 不太合适 |

| 对列和版式进行精确控制 | 有限 | 非常厉害 |

| 自定义规则管理 | 不错,但视野受限 | 非常厉害 |

| 对非标准XML的可重复性 | 变量 | 设计得当的话,效果会很好 |

这里的关键不在于初期的便利性,而在于可重复性。如果你每个月都收到相同的XML文件,并且总是希望得到相同的输出结果,那么一份优秀的样式表就能减少意外情况的发生。

没必要从复杂的转换开始。实际上,最好按以下方式操作:

实用建议:如果XML文件包含可选字段,请设计能处理缺失值的模板。这样可以避免列不稳定以及不同文件之间结果不一致的情况。

当数据在导入Excel之前需要进行标准化处理时,XSLT是最佳选择。这种情况常见于合规性检查、受监管的报表编制、ERP数据导出,或是数据流中——在这些场景下,虽然数据模式已知,但结构过于复杂,无法通过可视化方式进行干净利落的导入。

这种权衡非常明显。虽然初期需要投入更多时间,但能换来更稳定的运行。如果你的分析流程依赖于数据集的特定格式,这通常是最专业的方法。

当将XML转换为Excel成为日常工作时,手动操作便不再可行。这已不再是便利性的问题,而是运营能力的问题。而Python正是在这种情况下派上用场。

其主要优势不仅在于读取XML,更在于构建一个完整的处理流程:数据采集、验证、清理、标准化,以及最终以适合Excel或后续分析的格式进行写入。

在实际工作中,这意味着:

对于FatturaPA等大容量XML批量文件,这一问题已为人所知。 一项研究显示,72%的免费工具无法正确处理电子发票的结构. 该图表还显示,使用 Python 配合 pandas.read_xml 借助自定义功能,可以突破这些限制,并将原本需要手动操作的工作流程实现自动化,从而 55%的IT中小企业 (微软支持).

对于从事应用程序集成工作的人员而言 ELECTE API清晰地展现了这些流程的自然演进方向:文件不再是需要手动打开的附件,而是成为更广泛管道中一个自动化的环节。

没必要一开始就采用复杂的架构。通常,一个简单的流程就足够了:

pandas.read_xml.xlsx 或以某种中间格式关键在于解读背后的逻辑,而非解读本身。企业XML文件很少是完美的。它们包含命名空间、可选节点、重复字段和不规范的值。Python允许你在任何环节进行干预。

在以下三种场景中,Python 突破了手动方法的局限:

如果每天都有数十或数百个文件发送过来,你不可能逐一进行手动检查。脚本可以实现整个流程的标准化。

当类似的文件存在细微的结构差异时,Power Query往往需要频繁手动干预。在 Python 中,你可以引入异常处理、备用方案和条件映射。

在生成输出结果之前,您可以检查重复项、空字段、异常日期或缺失代码。在商业环境中,这一点往往比数据转换本身更为重要。

实用建议:请务必保存已处理文件及检测到的错误日志。当财务或运营部门询问为何报告中缺少某条记录时,日志可避免耗时的手动核查。

Python 需要更高的技术门槛。对于偶尔进行的分析而言,这可能有些过高。但对于海量数据和重复性流程,它在可控性、可扩展性和可靠性方面具有最佳的平衡。

商业价值不言而喻。若将“XML转Excel”转化为可重复执行的流程,您便无需再为每周的数据准备工作承担隐性成本。

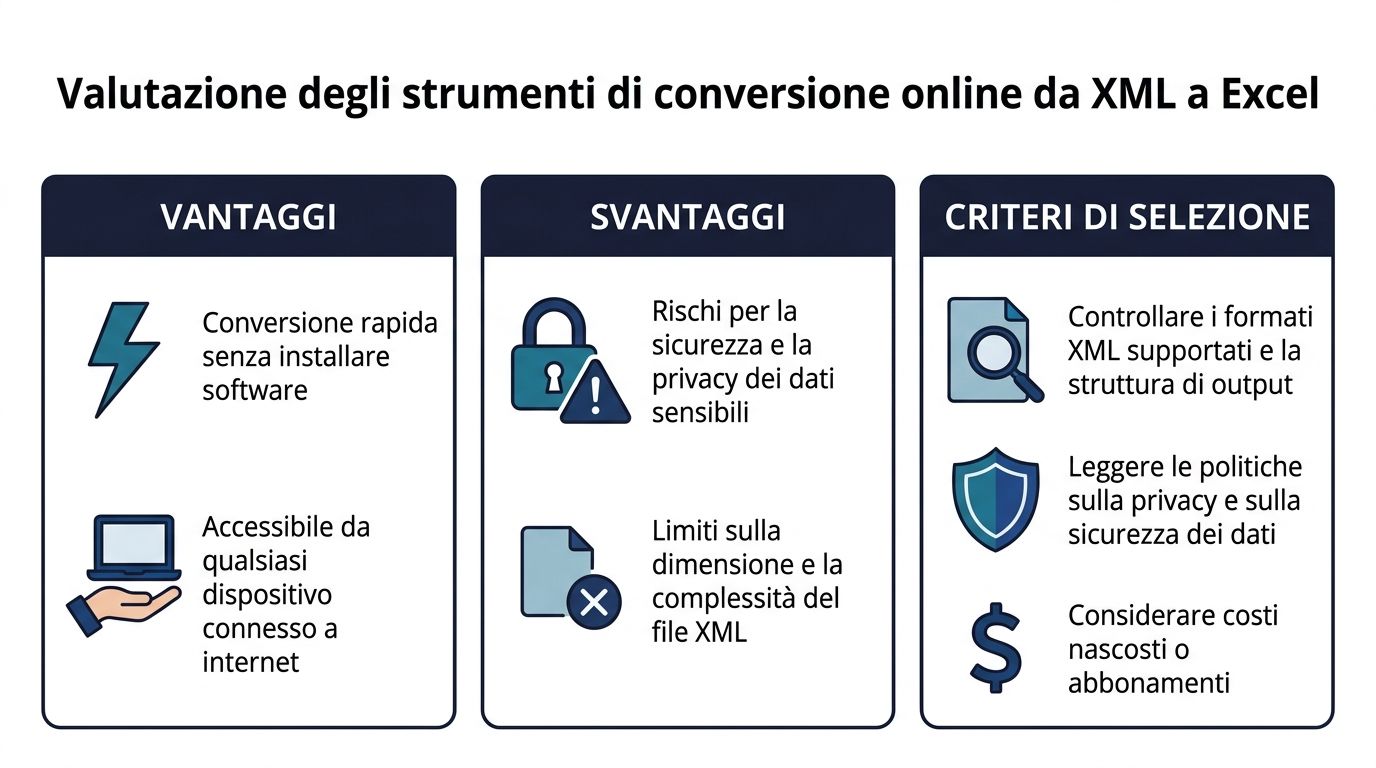

在线转换器之所以存在,原因很明确:它们速度快。上传文件、选择输出格式、下载文档。对于快速测试或非敏感文件,它们确实很有用。问题在于,这种初期的便利性往往掩盖了严重的操作限制。

主要优势显而易见:无需安装,无需配置,即刻可用。这使得它们非常适合处理简单文件或快速检查文件结构。

但一旦文件体积庞大或涉及敏感数据,情况就会发生变化。Excel 的行数上限为 1,048,576 行,这导致在处理大型 XML 文件时,有 62% 的情况会发生崩溃。因此,许多用户转而使用在线转换工具,这些工具最多可处理高达100 GB 的文件。 与此同时,Excel 2010 中的 Power Query 相比手动方法将导入时间缩短了 70%,这使得当文件大小在可控范围内且安全性至关重要时,原生功能变得极具竞争力(Sonra)。

在使用在线转换器之前,建议先检查以下三个方面:

数据敏感性

如果文件包含客户信息、财务数据、交易记录或受监管文件,将其上传至外部服务时需格外谨慎。

结构保真度

有些工具能很好地转换简单的XML,但会将复杂的层级结构压缩成难以使用的表格。

流程的可重复性

在线工具仅适用于一次性操作。如果工作流程需要反复执行,那么缺乏保存的规则和自动检查功能就会立即成为问题。

在某些情况下,这种用法是合理的:

| 场景 | 明智之选 |

|---|---|

| 测试文件或非敏感文件 | 是的,这样就行了 |

| 一次性分析 | 是的,如果结构简单的话 |

| 受监管或机密数据 | 最好避免 |

| 包含多行数据的周期性数据流 | 不太合适 |

从专业角度来看,标准很简单。如果你只是偶尔需要快速转换,在线转换器可以帮你解决问题。但如果你追求的是可靠的流程,它几乎从来都不是最佳选择。

一个XML文件看似已正确导入,却仍无法用于分析。这种情况在从ERP系统、API数据源、电子发票、产品目录和旧系统导出数据时经常发生。虽然导入过程没有明显错误,但在Excel中会出现重复行、空字段、日期被识别为文本,以及表头与详细信息之间关联丢失等问题。

关键在于:问题并不只出在导入环节。问题在于如何将层级结构转换为表格格式,同时又不丢失业务所需的上下文。

常见问题主要有四点:未管理的命名空间、过深的嵌套结构、不一致的数据类型以及导致最终文件体积膨胀的扁平化处理。这些问题都会产生切实的影响:报表数据不符、数据透视表毫无用处、验证时间延长,以及分析结果在提交给决策者之前需要进行手动修正。

如果目标是确保流程的可靠性,那么最好将这些情况视为设计规范,而非例外情况。

许多企业级XML文件会为文档的不同部分使用不同的前缀。如果Power Query、脚本或XSLT转换器未显式读取这些前缀,即使文件本身有效,某些节点仍会缺失。

实用解决方案:

此检查可避免一个常见问题。虽然导入看似成功,但订单行、地址或产品属性等整段内容却缺失了。

父子结构和一对多结构是最棘手的问题。如果将所有内容展开到同一张工作表中,Excel 会为每个子节点复制上级节点的数据。结果就是文件变大、运行变慢,且可读性降低。

实用解决方案:

实际上,订单、订单行和主数据作为关联表使用,比作为单一的扁平化数据表效果更好。

从技术上讲,一个有效的XML文件可能包含多种格式的日期、使用不同分隔符的数字、以字符串形式呈现的布尔字段以及空值,而Excel往往无法正确解析这些内容。问题随后便会出现:筛选结果有误、求和结果错误、排序不一致。

实用解决方案:

这是最值得优先自动化的检查之一,因为它能减少重复的手动更正,并提高报告的可靠性。

问题并不总是出在原始XML文件的体积上。通常情况下,Excel文件会变大,是因为在扁平化过程中关系被错误地复制了。每一行明细数据都附带了重复的主数据列,这会影响性能、打开速度以及分析质量。

实用解决方案:

对于简单的XML,一张表就足够了。但对于复杂的XML,几乎从来都不够。

最有效的方法是在Excel中保持一种轻量级的关系结构:一个表用于主要实体,一个表用于详细信息,另一个表用于引用。这样既能保留数据的含义,又能减少重复,并为构建更稳定的数据透视表、控件和分析模型做好准备。

这正是偶发性转换与企业级自动化之间的区别所在。如果该流程每周或每天都要重复,那么任何结构性错误都会导致时间浪费、手动检查以及报告延迟。因此,正确的问题不应仅仅是“如何在Excel中打开这个XML文件?”,而是“如何设置一种转换方案,使其在数据量不断增加、出现异常情况以及文件格式不断变化的情况下仍能保持可靠性?”。

这也是为端到端集成做准备的关键步骤。在Excel或中间数据表中经过规范化的XML数据,更容易集成到自动化处理流程、仪表盘ELECTE分析平台中,而初始数据结构的质量将直接影响最终决策的质量。

选择正确的方法并非严格意义上的技术问题,而是一个流程决策。正确的方法可以减少人工操作、降低出错率并缩短报告编制时间。

Power Query

对于简单或中等规模的文件、定期导入以及希望直接在 Excel 中工作的商务用户而言,这是最佳选择。

XSLT

当输出需要符合特定规则,且XML结构需要精细控制时,这是最佳选择。

Python

当处理流程属于批处理、高频操作或更广泛管道的一部分时应采用的方法。

在线工具

仅适用于快速转换,且仅限于非关键性文件且不包含敏感数据的情况。

在评估XML转Excel流程时,我会考虑以下四个问题:

| 问题 | 如果答案是“是” | 首选方法 |

|---|---|---|

| 文件是断断续续发来的吗? | 速度至关重要 | Power Query |

| 输出需要标准化吗? | 关键在于把控 | XSLT |

| 文件数量多且经常出现吗? | 可扩展性至关重要 | Python |

| 这只是个快速测试吗? | 即时性至关重要 | 在线 |

转换效率仅仅是效率的第一个层面。真正的优势在于,所选方法即使在面临运营压力时也能保持可靠性。

一个转换得当的XML文件能有效提升运营效率。当数据进入可靠的分析、监控和报告流程后,业务成果自然随之而来。

对于许多企业而言,Excel仍是数据验证、注释以及与财务、运营或销售部门共享的核心平台。在此环节,建议对版式、公式和校验规则进行标准化,尤其是当转换后的文件用于生成定期报告时。若您需要为这一阶段建立规范的基础框架,这些Excel模板有助于减少不必要的变体,并提升分析结果的可读性。

然而,其局限性很快便显现出来。如果文件数量增加、来源多样,或者报告需要频繁更新,那么仅依赖Excel的工作流程又会重新陷入依赖手动操作、临时的修改以及难以追踪的版本更新的困境。

要实现端到端的自动化,下一步就是搭建一个专用平台。

如果您希望从简单的XML转Excel操作升级到更具可扩展性的流程, ELECTE 将数据准备、分析和报告整合于单一平台。当您的目标不仅是将XML文件导入Excel,而是希望将数据流转化为预测分析、风险监控以及辅助决策的自动化报告时,这无疑是一个明智的选择。